شبکه هاپفیلد

شبکه هاپفیلد

شبکه هاپفیلد یک شکل از است عود شبکه عصبی مصنوعی توسط محبوبیت جان هاپفیلد در سال 1982، اما قبل از آن توسط کوچک در سال 1974. توصیف [1] [2] شبکه هاپفیلدبه عنوان خدمت محتوای-آدرس ( "انجمنی") حافظه سیستم با باینری آستانه گره . آنها به همگرا به تضمین حداقل محلی و، بنابراین، ممکن است به یک الگوی نادرست (حداقل محلی اشتباه) به جای الگوی ذخیره شده (انتظار می رود حداقل محلی) همگرا [ نیازمند منبع ] . شبکه های هاپفیلدهمچنین مدلی را برای درک حافظه انسان ارائه می دهند [3] [4].

فهرست

ساختار [ ویرایش ]

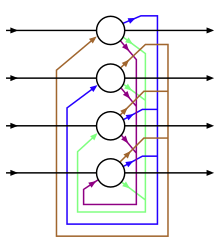

یک هاپفیلد با چهار واحد.

واحدهای موجود در شبکه هاپفیلد واحدهای آستانه باینری هستند ، یعنی واحدها فقط دو مقدار متفاوت را برای حالتهای خود در نظر می گیرند و مقدار با تعیین اینکه ورودی واحدها از آستانه آنها فراتر رفته یا نه تعیین می شود. شبکه های هاپفیلدبه طور معمول دارای واحدهایی هستند که مقادیر 1 یا -1 را در بر می گیرند و در این مقاله از این کنوانسیون استفاده می شود. با این وجود ، سایر ادبیات ممکن است از واحدهایی استفاده کنند که مقادیر 0 و 1 را در بر می گیرند.

هر جفت واحدی i و j در یک شبکه هاپفیلد یک اتصال دارند که با وزن اتصال توصیف می شود

اتصالات موجود در یک هاپفیلد به طور معمول دارای محدودیت های زیر هستند:

(هیچ واحدی با خودش ارتباط ندارد)

(اتصالات متقارن هستند)

این محدودیت که وزنها متقارن هستند تضمین می کند که عملکرد انرژی در حالی که پیروی از قوانین فعال سازی می شود به صورت یکنواخت کاهش می یابد. [5] شبکه ای با وزنهای نامتقارن ممکن است رفتارهای دورهمی یا آشفتگی را نشان دهد. با این حال ، هاففیلد دریافت که این رفتار محدود به قسمتهای نسبتاً کوچکی از فضای فاز است و توانایی شبکه در عملکرد به عنوان یک سیستم حافظه انجمنی با آدرس محتوا را مختل نمی کند.

به روزرسانی [ ویرایش ]

به روز کردن یک واحد (گره در نمودار شبیه سازی نورون مصنوعی) در شبکه هاپفیلد با استفاده از قانون زیر انجام می شود:

جایی که:

استحکام وزن اتصال از واحد j به واحد i (وزن اتصال) است.

وضعیت واحد من است

آستانه واحد من است.

به روزرسانی ها در شبکه هاپفیلد به دو روش مختلف قابل انجام است:

ناهمزمان : فقط یک واحد در یک زمان به روز می شود. این واحد را می توان به طور تصادفی انتخاب کرد ، یا می توان سفارش از پیش تعریف شده را از همان ابتدا تحمیل کرد.

همگام سازی : همه واحدها به طور هم زمان به روز می شوند. به منظور حفظ هماهنگی ، به یک ساعت مرکزی به سیستم احتیاج دارد. این روش با توجه به عدم وجود ساعت جهانی مشاهده شده در سیستم های بیولوژیکی یا جسمی مورد علاقه ، به همان اندازه کمتر واقع بینانه مشاهده می شود.

نورونها "همدیگر را جذب یا دفع می کنند" در فضای حالت [ ویرایش ]

وزن بین دو واحد تأثیر بسیار خوبی بر روی مقادیر نورونها دارد. وزن اتصال را در نظر بگیرید

چه زمانی

، سهم j در جمع وزنی مثبت است. بدین ترتیب،

توسط j به سمت مقدار خود کشیده می شود

چه زمانی

، سهم j در مبلغ وزنی منفی است. بعد دوباره

توسط j به سمت ارزش خود سوق می یابد

بنابراین ، اگر وزن بین آنها مثبت باشد ، مقادیر نورون های i و j به همگرایی خواهند رسید. به همین ترتیب ، اگر وزن منفی باشد ، از هم فاصله می گیرند.

انرژی [ ویرایش ]

منظره انرژی یک شبکه هاففیلد ، برجسته کردن وضعیت فعلی شبکه (از بالای تپه) ، یک حالت جذب کننده که در نهایت به همگرایی می رسد ، حداقل سطح انرژی و یک حوضه جاذبه به رنگ سبز ساییده می شود. توجه داشته باشید که همیشه به روزرسانی شبکه هاپفیلددر انرژی کم می شود.

شبکه های هاپفیلد دارای مقیاس مقیاس همراه با هر حالت از شبکه هستند که به آن "انرژی" ، E ، شبکه گفته می شود ، جایی که:

این مقدار "انرژی" نامیده می شود زیرا با به روزرسانی واحدهای شبکه همان کاهش می یابد یا همان باقی می ماند. علاوه بر این ، با به روزرسانی مکرر شبکه سرانجام به وضعیتی که حداقل محلی در عملکرد انرژی [ استناد مورد نیاز ] است (که تابعی از لیاپونف محسوب می شود ) تبدیل می شود. بنابراین ، اگر یک کشور حداقل محلی در عملکرد انرژی باشد ، یک وضعیت پایدار برای شبکه است. توجه داشته باشید که این عملکرد انرژی متعلق به یک کلاس کلی از مدل های فیزیک تحت عنوان مدل های ایسینگ است . این به نوبه خود یک مورد خاص از شبکه های مارکوف است ، از آنجا که اندازه گیری احتمال مرتبط ،اندازه گیری گیبس ، خاصیت مارکوف را دارد .

شروع و اجرا [ ویرایش ]

اولیه سازی شبکه هاپفیلد با تنظیم مقادیر واحدها در الگوی شروع مطلوب انجام می شود. به روز رسانی های مکرر سپس انجام می شود تا اینکه شبکه به یک الگوی جذب تبدیل شود. همگرایی به طور کلی اطمینان دارد ، زیرا هاپفیلد ثابت کرد که جذب این سیستم دینامیکی غیرخطی ثابت است ، نه دوره ای و یا هرج و مرج مانند برخی از سیستم های دیگر [ نیاز به استناد ] . بنابراین ، در زمینه شبکه های هافیلد ، الگوی جذب یک وضعیت پایدار نهایی است ، الگویی که با به روزرسانی [ استناد مورد نیاز ] نمی تواند هیچ ارزشی را در درون خود تغییر دهد .

آموزش [ ویرایش ]

آموزش یک شبکه هاپفیلد شامل پایین آمدن انرژی حالت هایی است که شبکه باید "بخاطر بسپارد". این امر به شبکه اجازه می دهد تا به عنوان یک سیستم حافظه با قابلیت آدرس محتوا عمل کند ، یعنی اگر فقط بخشی از حالت به آن داده شود ، شبکه به حالت "یادآوری" تبدیل می شود. از شبکه می توان برای بازیابی از ورودی تحریف شده به حالت آموزش دیده که بیشتر شبیه به آن ورودی است استفاده کرد. به این حافظه انجمنی گفته می شود زیرا بر اساس شباهت ، خاطرات را بازیابی می کند. به عنوان مثال ، اگر ما یک شبکه هاپفیلدرا با پنج واحد آموزش دهیم به طوری که حالت (1 ، -1 ، 1 ، -1 ، 1) حداقل انرژی باشد و حالت را به شبکه (1 ، -1 ، -1 ، -1 ، 1) به (1 ، -1 ، 1 ، -1 ، 1) تبدیل می شود. بنابراین ، شبکه به درستی آموزش داده می شود وقتی انرژی حالت هایی که شبکه باید از آن یاد کند حداقل های محلی است. توجه داشته باشید که ، آموزش ، آستانه های نورون ها هرگز به روز نمی شوند.

قوانین یادگیری [ ویرایش ]

قوانین مختلف یادگیری مختلفی وجود دارد که می تواند برای ذخیره اطلاعات در حافظه شبکه هاپفیلداستفاده شود. برای یک قانون یادگیری مطلوب است که هر دو ویژگی زیر را داشته باشد:

محلی : یک قانون یادگیری محلی است اگر هر وزن با استفاده از اطلاعات موجود برای سلولهای عصبی در هر طرف از اتصال که با آن وزن خاص همراه است ، به روز شود.

افزایشی : الگوهای جدید را می توان بدون استفاده از اطلاعات از الگوهای قدیمی که برای آموزش نیز استفاده شده است آموخت. یعنی وقتی الگوی جدیدی برای آموزش استفاده می شود ، مقادیر جدید وزن فقط به مقادیر قدیمی و الگوی جدید بستگی دارد. [6]

این خصوصیات مطلوب است ، زیرا یک قانون یادگیری راضی کننده آنها از نظر زیست شناختی قابل قبول تر است. به عنوان مثال ، از آنجا که مغز انسان همیشه در حال یادگیری مفاهیم جدید است ، می توان دلیل آن را یاد گرفت که انسان افزایشی است. یک سیستم یادگیری که افزایشی نبوده است ، به طور کلی تنها با یک بار آموزش داده می شود ، با یک مجموعه عظیم از داده های آموزشی.

قانون یادگیری هبیان برای شبکه های هاپفیلد [ ویرایش ]

نظریه Hebbian توسط دونالد Hebb در سال 1949، به منظور توضیح "یادگیری انجمنی"، که در آن همزمان با فعال نمودن سلول نورون منجر به افزایش تلفظ در قدرت سیناپسی بین این سلول ها معرفی شد. [7] غالباً با عنوان "نورون هایی که با هم آتش می گیرند ، خلاصه می شوند. نورون هایی که از همگام سازی خارج می شوند ، پیوند ندارند."

قانون هبیان هم محلی و هم افزایشی است. برای شبکه های هاپفیلد، هنگام یادگیری به روش زیر پیاده سازی می شود

جایی که

اگر بیت های مربوط به نورون های i و j از نظر الگوی مساوی باشند

قانون یادگیری استورکی [ ویرایش ]

این قانون توسط Amos Storkey در سال 1997 معرفی شده و هم محلی و هم افزایشی است. استورکی همچنین نشان داد که یک شبکه هاففیلد که با استفاده از این قانون آموزش دیده است ظرفیت بیشتری نسبت به یک شبکه مربوطه دارد که با استفاده از قانون هبیان آموزش دیده است. [8] گفته می شود که ماتریس وزن یک شبکه عصبی جذب کننده ( روشن شدن مورد نیاز ) در صورت اطاعت از قانون یادگیری استورکی پیروی می کند:

این قانون یادگیری محلی است ، زیرا سیناپسها فقط نورونهای طرف آنها را در نظر می گیرند. این قانون به دلیل تأثیر میدان محلی ، از اطلاعات بیشتر در مورد الگوهای و وزنها نسبت به قاعده عمومی هبیان استفاده می کند.

الگوهای فریبنده [ ویرایش ]

الگویی که شبکه از آن برای آموزش استفاده می کند (موسوم به حالت های بازیابی ) جذب کننده سیستم می شوند. به روزرسانی های مکرر در نهایت منجر به همگرایی یکی از حالت های بازیابی می شود. با این حال ، گاهی اوقات شبکه به الگوهای فریبنده (متفاوت از الگوهای آموزشی) همگرا می شود. [9] انرژی موجود در این الگوهای شگرف نیز حداقل محلی است. برای هر الگوی ذخیره شده x ، negation -x نیز الگویی جالب است.

حالت فریبنده همچنین می تواند ترکیبی خطی از تعداد عجیب حالتهای بازیابی باشد. به عنوان مثال ، هنگام استفاده از 3 الگوی

الگوهای توهمی که تعداد یکنواخت حالت دارند ، نمی توانند وجود داشته باشند ، زیرا ممکن است تا صفر برسد [9]

ظرفیت [ ویرایش ]

ظرفیت شبکه مدل شبکه هاپفیلد با مقادیر نورون و اتصالات درون یک شبکه معین تعیین می شود. بنابراین ، تعداد حافظه هایی که قادر به ذخیره هستند بستگی به سلولهای عصبی و اتصالات دارد. علاوه بر این ، نشان داده شد که دقت فراخوانی بین بردارها و گرهها 0.138 بود (تقریباً 138 بردار را می توان برای ذخیره سازی برای هر 1000 گره فراخوانی کرد) (هرتز و همکاران ، 1991). بنابراین ، بدیهی است که اگر کسی بخواهد تعداد زیادی از بردارها را ذخیره کند ، بسیاری از اشتباهات رخ خواهد داد. وقتی مدل هاپفیلد الگوی صحیح را به یاد نمی آورد ، ممکن است یک رخنه رخ داده باشد ، زیرا موارد مرتبط با معنایی تمایل به سردرگمی فرد دارند و یادآوری الگوی اشتباه رخ می دهد. بنابراین ، مدل شبکه هافیلد نشان داده شده است که هنگام بازیابی ، یک مورد ذخیره شده را با موارد دیگر اشتباه می گیرد. فراخوانی کامل و ظرفیت بالا ،> 0.14> ، می تواند در شبکه با روش یادگیری Storkey بارگیری شود. ETAM[10] [11] ، آزمایش های ETAM نیز در [12] . بعداً مدلهای جلوی الهام گرفته شده از شبکه هافیلد برای بالا بردن حد ذخیره و کاهش میزان خطای بازیابی ساخته شدند که برخی از آنها قادر به یادگیری یک شات هستند . [13]

حافظه انسانی [ ویرایش ]

مدل هافیلد حافظه انجمنی را تشکیل می دهداز طریق ترکیب بردارهای حافظه. بردارهای حافظه اندکی قابل استفاده هستند و این باعث می شود بازیابی شبیه ترین بردار در شبکه ایجاد شود. با این حال ، خواهیم فهمید که به دلیل این روند ، نفوذی رخ می دهد. در حافظه انجمنی برای شبکه هاپفیلد ، دو نوع عملیات وجود دارد: انجمن خودکار و هترو انجمن. حالت اول وقتی یک بردار با خود همراه است و دومی وقتی است که دو بردار مختلف در انبار قرار دارند. علاوه بر این ، هر دو نوع عملیات برای ذخیره در یک ماتریس حافظه واحد امکان پذیر است ، اما تنها درصورتی که ماتریس نمایندگی داده شده یکی یا دیگری از این عملیات ها نباشد ، بلکه ترکیب (خودکار پیوستگی و ناهمگن) از این دو است. لازم به ذکر است که مدل شبکه هاپفیلد از همان قاعده یادگیری استفاده می کندقانون یادگیری هب (1949) ، که اساساً سعی کرده است نشان دهد که یادگیری در نتیجه تقویت وزنه ها هنگام وقوع فعالیت رخ می دهد.

Rizzuto و Kahana (2001) توانستند با استفاده از یک الگوریتم یادگیری احتمالی ، نشان دهند که مدل شبکه عصبی می تواند تکرار دقت فراخوان را به حساب آورد. در طی فرآیند بازیابی ، هیچ یادگیری رخ نمی دهد. در نتیجه ، وزن شبکه ثابت باقی می ماند و نشان می دهد که این مدل قادر است از یک مرحله یادگیری به مرحله فراخوان تبدیل شود. آنها با افزودن پیمایش متنی توانستند فراموشی سریع را که در یک مدل هاپفیلد در طی یک کار پس انداز فراخوان رخ می دهد ، نشان دهند. کل شبکه به تغییر در فعال سازی هر گره منفرد کمک می کند.

قانون دینامیکی مک کالوچ و پیتز (1943) ، که رفتار نورون ها را توصیف می کند ، به روشی انجام می شود که نشان می دهد چگونه فعالیت های چندین نورون بر روی فعال شدن سرعت شلیک نورون جدید و چگونگی تقویت وزن نورون ها انجام می شود. اتصالات سیناپسی بین نورون فعال جدید (و آنهایی که آن را فعال می کنند). هاپفیلد از قاعده دینامیکی مک کالوچ-پیتز برای نشان دادن چگونگی امکان بازیابی در شبکه هاپفیلد استفاده می کند. با این حال ، توجه به این نکته مهم است که هاپفیلد این کار را با روشی تکراری انجام می داد. هافیلد به جای استفاده از یک تابع خطی ، از یک تابع فعال سازی غیرخطی استفاده می کند. بنابراین ، این امر باعث ایجاد قانون دینامیکی هاپفیلد می شود و با این کار ، هاپفیلد توانست نشان دهد که با عملکرد فعال سازی غیرخطی ،

منبع